KI und Desinformation in Social Media: Risiken & Chancen für KMU

Was Sie sehen, ist nicht mehr das, was passiert ist. Im Februar 2026 sind KI-generierte Videos, Bilder und Texte auf Social Media so überzeugend, dass selbst erfahrene Journalisten sie nicht immer von echten Inhalten unterscheiden können. Deepfakes beeinflussen Wahlen, synthetische Bot-Netzwerke steuern öffentliche Debatten, und „Decline Porn“ — KI-generierte Verfallsbilder von Großstädten — treibt Millionen Menschen in Angst und politische Radikalisierung. Gleichzeitig bietet KI auch Chancen: bessere Content-Moderation, kreative Werkzeuge und intelligentere Faktenprüfung. Dieser Artikel zeigt, was gerade passiert, wer dahintersteckt und was Unternehmen und Privatpersonen dagegen tun können.

Was sind Deepfakes — und warum sind sie 2026 so gefährlich?

Deepfakes sind synthetische Medien — Videos, Bilder oder Audiodateien —, die mithilfe von Künstlicher Intelligenz erzeugt werden und reale Personen oder Ereignisse täuschend echt nachbilden. Was vor wenigen Jahren noch als erkennbar amateurhafte Spielerei galt, hat 2026 ein Niveau erreicht, das Professional-Grade-Produktion übertrifft: Stimmen werden in Echtzeit geklont, Gesichter in bestehende Videos eingefügt und ganze Szenarien aus dem Nichts generiert — inklusive natürlicher Lippenbewegungen, authentischer Beleuchtung und kohärenter Hintergrundgeräusche.

Das Problem ist nicht die Technologie selbst — sondern ihre Verfügbarkeit. Tools wie Sora von OpenAI, Grok von xAI und zahlreiche Open-Source-Modelle ermöglichen es praktisch jedem, hyperrealistische synthetische Medien zu erzeugen. Adam Mosseri, Chef von Instagram, brachte die Situation auf den Punkt: „Authenticity is becoming infinitely reproducible“ — Authentizität wird unendlich reproduzierbar.

KI-Bots und synthetische Inhalte: Die unsichtbare Armee

Deepfakes sind nur die sichtbarste Spitze eines viel größeren Problems. Unter der Oberfläche operieren KI-gesteuerte Bot-Netzwerke, die koordiniert Desinformation verbreiten. Diese Bots sind keine plumpen Spam-Accounts mehr — sie führen menschenähnliche Konversationen, reagieren kontextbezogen auf aktuelle Ereignisse und bauen über Monate hinweg glaubwürdige Profile auf.

Eine besonders perfide Spielart sind pro-russische KI-generierte Propagandavideos, die auf Social-Media-Plattformen zirkulieren. Der MIT Technology Review berichtete im Februar 2026, dass bei solchen Videos Kommentare, die auf die KI-Generierung hinwiesen, deutlich weniger Engagement erhielten als Kommentare, die den Inhalt als echt behandelten. Die Algorithmen der Plattformen belohnen also faktisch die Verbreitung von Desinformation. Noch beunruhigender: Wachsende Evidenz zeigt, dass Menschen von KI-generierten Inhalten beeinflusst werden, „even when they know that it is false“ — selbst wenn sie wissen, dass diese falsch sind.

Laut einer Studie, die The Verge im Februar 2026 zitierte, machte KI-genierter Content bereits 10 Prozent der am schnellsten wachsenden YouTube-Kanäle im Juli 2024 aus. Dieser Anteil dürfte seitdem erheblich gestiegen sein. Die Plattformen profitieren davon: Mehr Content bedeutet mehr Engagement, mehr Engagement bedeutet mehr Werbeeinnahmen. Ben Colman, CEO von Reality Defender, einem Unternehmen für Deepfake-Erkennung, sagte gegenüber The Verge: „Platforms have wholeheartedly embraced deepfakes and AI slop […] it’s yet another kind of content to keep users on the platform longer and push more ads.“

„Decline Porn“: Wie KI-generierte Verfallsbilder gezielt ältere Generationen täuschen

Ein besonders alarmierendes Phänomen dokumentierte die BBC-Journalistin Marianna Spring im Februar 2026: sogenanntes „Decline Porn“. Dabei handelt es sich um KI-generierte Videos, die britische Innenstädte als verwahrloste, von Kriminalität und Verfall geprägte Orte darstellen — obwohl die gezeigten Szenen nie stattgefunden haben.

Der Ersteller dieser Videos, der unter dem Pseudonym „RadialB“ agiert, gab in einem Interview offen zu, dass er bewusst eine ältere Zielgruppe anspricht: Menschen zwischen 50 und 60 Jahren, die mit KI nicht aufgewachsen sind und die generierten Bilder nicht als synthetisch erkennen können. Das Ergebnis lässt sich in den Kommentarspalten dieser Videos beobachten — Spring beschrieb, wie „50-year-olds and 60-year-olds in the comments raging and saying all this political stuff“ zu sehen waren. Menschen, die auf Basis von KI-generierten Fälschungen politische Meinungen bilden.

Der TikTok-Nutzer C.Tino, der diese Videos als KI-generiert entlarvte, warnte: „These videos are making people think this is real life. It’s becoming out of hand now.“

Die realen Auswirkungen sind messbar: YouGov-Daten zeigen, dass eine Mehrheit der Briten London für unsicher hält — obwohl 81 Prozent der Londoner selbst sagen, dass ihre eigene Nachbarschaft sicher ist. KI-generierte Verfallsbilder verstärken eine verzerrte Wahrnehmung der Realität und treiben politische Radikalisierung. Elon Musk selbst teilte solche Narrative und kommentierte: „What I see happening is a destruction of Britain. Initially a slow erosion, but a rapidly increasing erosion of Britain with massive uncontrolled migration.“ — eine Aussage, die durch KI-generierte Bilder eines vermeintlichen Verfalls visuell „belegt“ wird, obwohl die gezeigten Szenen nie existiert haben.

Auswirkungen auf Politik, Wirtschaft und Gesellschaft

KI-generierte Desinformation ist kein abstraktes Technologieproblem — sie greift direkt in demokratische Prozesse, wirtschaftliche Entscheidungen und zwischenmenschliche Beziehungen ein.

Politik: Wenn Fakten beliebig werden

Die politische Dimension ist besonders besorgniserregend. Im Februar 2026 berichtete der MIT Technology Review, dass das Weiße Haus ein manipuliertes Bild eines Protestierenden in Minnesota teilte und anschließend diejenigen verspottete, die nach der Authentizität fragten. Gleichzeitig nutzt das US-Heimatschutzministerium (DHS) KI-Tools von Google und Adobe, um Inhalte zu erstellen, die mit der Öffentlichkeit geteilt werden. Wenn Regierungen selbst synthetische Medien einsetzen und die Grenzen zwischen authentischem und generiertem Content verwischen, wird es für Bürger nahezu unmöglich, fundierte demokratische Entscheidungen zu treffen.

Eric Horvitz, Chief Scientific Officer von Microsoft, betonte im MIT Technology Review-Interview: „Governments have not been outside the sectors that have been behind various kinds of manipulative disinformation.“ — Regierungen sind keineswegs außerhalb der Gruppen, die hinter verschiedenen Formen manipulativer Desinformation stehen.

In den USA wurden unter der Trump-Administration zudem Fördermittel für Desinformationsforschung gestrichen: Die Initiative DOGE strich NSF-Grants, die der wissenschaftlichen Erforschung von Desinformation dienten. Damit fehlt zunehmend unabhängige Forschung zu einem Problem, das exponentiell wächst.

Wirtschaft: Vertrauensverlust als Geschäftsrisiko

Für Unternehmen — insbesondere KMU — hat KI-Desinformation direkte wirtschaftliche Konsequenzen. Deepfake-Betrugsmaschen, bei denen Stimmen von Geschäftsführern geklont und für betrügerische Überweisungen genutzt werden, verursachen jährlich Schäden in Milliardenhöhe. Doch selbst ohne direkte Betrugsschäden untergräbt die allgemeine Erosion des Vertrauens in digitale Inhalte das Online-Marketing: Wenn Kunden nicht mehr sicher sind, ob ein Testimonial echt oder ein Produktvideo authentisch ist, leidet die Conversion Rate — und damit der Umsatz.

Beziehungen: Die persönliche Dimension

Die Auswirkungen auf zwischenmenschliche Beziehungen sind ebenso gravierend, wenn auch weniger sichtbar. Paul Vane, Informationskommissar von Jersey, formulierte es im Februar 2026 so: „AI tools that can generate or alter images and video are advancing rapidly. When used responsibly they hold tremendous promise. But as recent reporting makes clear, they are already being used to harm real people.“ — KI-Tools, die Bilder und Videos erzeugen oder verändern können, entwickeln sich rasant weiter. Verantwortungsvoll eingesetzt bergen sie enormes Potenzial. Aber wie aktuelle Berichte zeigen, werden sie bereits jetzt eingesetzt, um echten Menschen zu schaden. 60 Aufsichtsbehörden weltweit unterzeichneten eine gemeinsame Erklärung zu KI-generierter Bild- und Videopraxis.

Wie stehen die Tech-Konzerne dazu? Positionen im Überblick

Die Frage, ob Big Tech es ernst meint mit dem Kampf gegen KI-Desinformation, beantwortete die Verge-Journalistin Jess Weatherbed am 23. Februar 2026 mit einer vernichtenden Analyse. Ihre zentrale These: Die Plattformen verdienen an KI-generierten Inhalten — und haben daher keinen wirtschaftlichen Anreiz, das Problem wirklich zu lösen.

X (Twitter) und Elon Musk: Der größte Rückschritt

X — ehemals Twitter — war Gründungsmitglied der C2PA (Coalition for Content Provenance and Authenticity), dem wichtigsten Industriestandard zur Kennzeichnung synthetischer Inhalte. Nach Elon Musks Übernahme trat die Plattform aus der Initiative aus. Andy Parsons, Senior Director of Content Authenticity bei Adobe, bestätigte gegenüber The Verge, dass X „not involved with C2PA“ sei.

Die Konsequenzen sind gravierend: Musk selbst teilte irreführende Deepfakes auf seiner eigenen Plattform, Grok — xAIs hauseigenes KI-Modell — erzeugte gewalttätige und sexualisierte Deepfakes. The Verge konstatierte, dass X „no interest in protecting its 270 million daily users from AI fakery“ habe — kein Interesse daran, seine 270 Millionen täglichen Nutzer vor KI-Fälschungen zu schützen.

Meta / Instagram: Zwischen Lippenbekenntnissen und Geschäftsinteressen

Meta trat der C2PA im September 2024 bei und führte „AI Info“-Labels auf Instagram ein. Die Realität sieht allerdings ernüchternd aus: Das Label ist laut The Verge klein, schwer zu finden, inkonsistent platziert und fehlt auf dem Desktop teilweise komplett. Gleichzeitig baut Meta eine Instagram-Alternative, die laut Weatherbeds Recherche „entirely AI slop“ sei — eine Plattform aus komplett KI-generierten Inhalten.

Hany Farid, Professor für digitale Forensik an der UC Berkeley, brachte das Dilemma auf den Punkt: „If the Mark Zuckerbergs and the Elon Musks of the world think that putting ‚AI generated‘ labels on something will reduce engagement, then of course they’re incentivized not to do it.“ — Wenn die Zuckerbergs und Musks dieser Welt glauben, dass ein „KI-generiert“-Label das Engagement senkt, haben sie natürlich keinen Anreiz, es umzusetzen.

Google und SynthID: Der ambitionierteste technische Ansatz

Google DeepMind verfolgt mit SynthID den aktuell ambitioniertesten technischen Ansatz: unsichtbare digitale Wasserzeichen, die in KI-generierte Bilder, Audio, Text und Videos eingebettet werden und auch nach Modifikationen wie Zuschneiden, Filter oder Komprimierung erhalten bleiben. Ein SynthID Detector-Portal ermöglicht die Überprüfung, und die Integration in Gemini erlaubt es Nutzern, die Herkunft von Inhalten zu verifizieren. Gleichzeitig ersetzt Google auf YouTube zunehmend originale News-Headlines durch KI-generierte Zusammenfassungen — ein Widerspruch, der die Glaubwürdigkeit des eigenen Transparenzansatzes unterminiert.

OpenAI: C2PA-Mitglied mit Einschränkungen

OpenAI sitzt im Steering Committee der C2PA und bekennt sich öffentlich zum Responsible Deployment: „We cautiously and gradually release new AI systems—with substantial safeguards in place.“ Gleichzeitig räumt das Unternehmen offen ein, dass C2PA-Metadaten „easily be removed either accidentally or intentionally“ können — also leicht entfernbar sind, ob versehentlich oder absichtlich. Mit Sora bietet OpenAI ein mächtiges KI-Videotool an, das qualitativ hochwertige synthetische Videos für zahlende Abonnenten erzeugt.

Anthropic: Sicherheit als Geschäftsmodell

Anthropic, das Unternehmen hinter Claude, nimmt eine Sonderstellung ein. Es betreibt keine eigene Social-Media-Plattform und verweigerte explizit eine Militärnutzung durch das Pentagon. In seinen veröffentlichten „Core Views on AI Safety“ formulierte das Unternehmen: „We do not know how to train systems to robustly behave well“ — Wir wissen nicht, wie man Systeme trainiert, die sich zuverlässig korrekt verhalten. Anthropic verspricht, „den Alarm zu schlagen“, sollte die Evidenz zeigen, dass KI-Sicherheit ein unlösbares Problem ist.

Microsoft: Zwischen Ambition und Inkonsequenz

Microsoft ist Mitgründer der C2PA seit 2021 und veröffentlichte im Februar 2026 ein neues „Blueprint“ für Content-Authentifizierung, bei dem 60 verschiedene Kombinationen aus Provenance- und Wasserzeichen-Methoden evaluiert wurden. Eric Horvitz, Microsofts Chief Scientific Officer, betonte: „It’s not about making any decisions about what’s true and not true. It’s about coming up with labels that just tell folks where stuff came from.“ — Es geht nicht darum zu entscheiden, was wahr ist und was nicht. Es geht darum, Labels zu entwickeln, die den Leuten einfach sagen, woher etwas stammt. Kritiker bemängeln jedoch, dass Microsoft die eigenen Empfehlungen in seinen Produkten nicht konsequent umsetzt — und als Großinvestor bei OpenAI wirtschaftlich von der KI-Content-Produktion profitiert.

C2PA und KI-Labeling: Funktioniert die Kennzeichnung?

Die Coalition for Content Provenance and Authenticity (C2PA) ist der aktuell wichtigste Industriestandard zur Kennzeichnung synthetischer Inhalte. Co-gegründet 2021 von Adobe, Microsoft, Intel und der BBC, definiert C2PA technische Spezifikationen, mit denen digitale Inhalte eine Art digitales Herkunftszertifikat erhalten — ähnlich einem Echtheitssiegel für Bilder, Videos und Audiodateien.

Das Problem: C2PA funktioniert auf freiwilliger Basis. The Verge bezeichnete den Standard als „glorified honor system“ — ein glorifiziertes Ehrensystem — und betonte, dass er auch nie als ultimative Lösung gegen Deepfakes konzipiert war. Andy Parsons von Adobe bestätigte: „This is not a silver bullet. It does solve a whole class of problems.“ — Dies ist keine Wunderwaffe. Aber es löst eine ganze Kategorie von Problemen.

Die Zahlen sprechen eine deutliche Sprache: Eine von The Verge zitierte Indicator-Studie ergab, dass nur 30 Prozent der getesteten KI-generierten Posts auf Plattformen wie Instagram, LinkedIn, Pinterest, TikTok und YouTube korrekt als KI-generiert gekennzeichnet waren. 70 Prozent blieben unmarkiert. Auf X/Twitter liegt die Rate bei null Prozent — dort findet schlicht keinerlei KI-Kennzeichnung statt. Einzig Googles SynthID erreicht eine Erkennungsrate, die in internen Tests bei rund 80 Prozent liegt — allerdings nur bei Inhalten, die mit Google-eigenen Tools generiert wurden.

Eine in Nature veröffentlichte Studie ergab zudem, dass Transparenz-Warnungen allein nicht ausreichen. Die Forscher fanden „little empirical evidence to support the effectiveness of AI transparency“ — wenig empirische Evidenz für die Wirksamkeit von KI-Transparenz. Selbst wenn Nutzer wissen, dass ein Inhalt KI-generiert ist, beeinflusst er ihre Meinungsbildung.

Ab August 2026 tritt in Kalifornien der AI Transparency Act in Kraft — ein Gesetz, das KI-Labeling erstmals verpflichtend macht. Ob es als Modell für eine globale Regulierung dienen kann, bleibt abzuwarten.

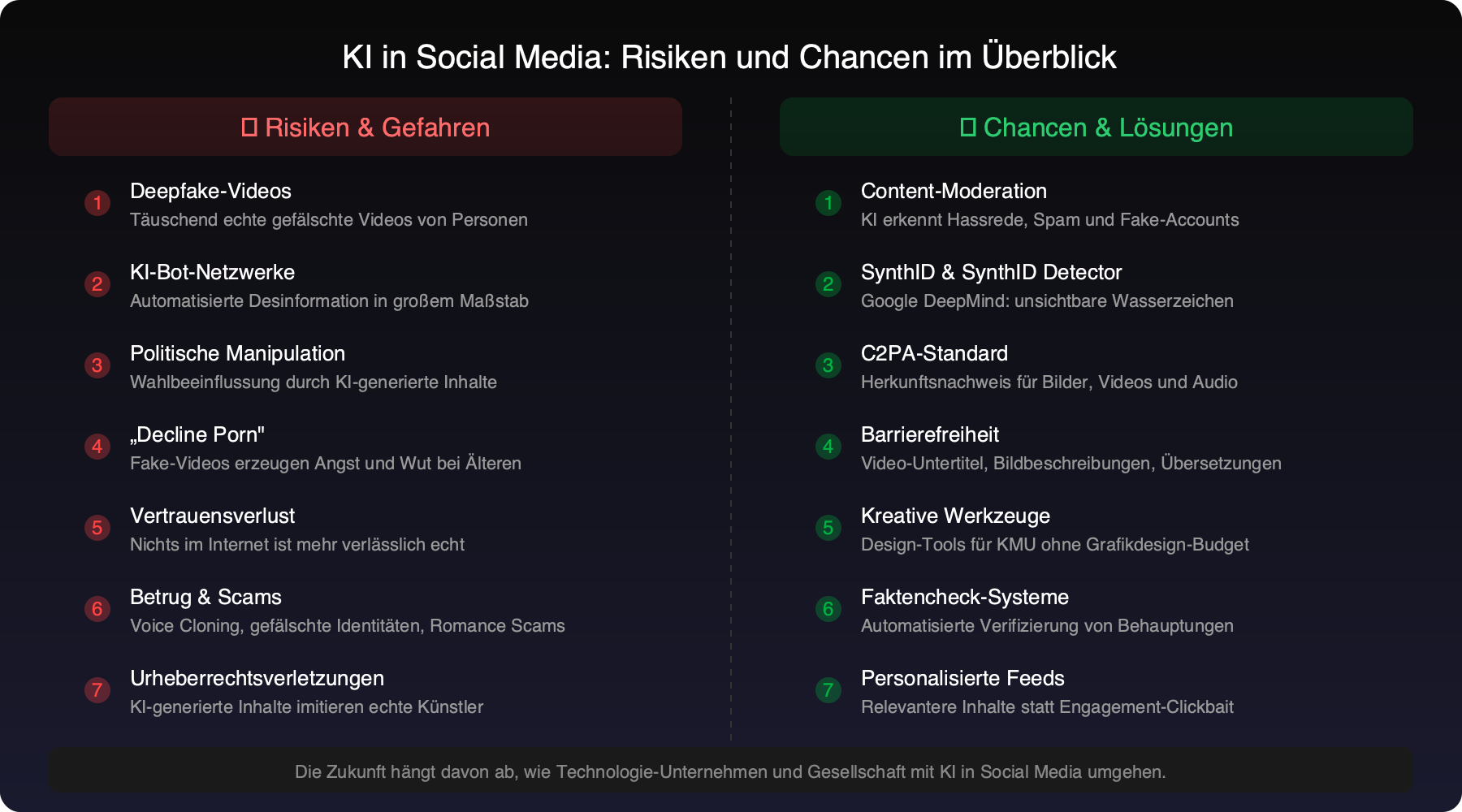

Die Risiken im Überblick: Was KI auf Social Media anrichtet

Die andere Seite: Was KI auf Social Media Positives bewirkt

Bei all den berechtigten Bedenken wäre es unfair — und auch faktisch falsch —, KI auf Social Media nur als Bedrohung darzustellen. Dieselbe Technologie, die Deepfakes erzeugt, bietet auch wirkungsvolle Werkzeuge gegen Desinformation und für kreative, barrierefreie Nutzung.

Content-Moderation in Echtzeit

KI-gestützte Moderationssysteme können Hassrede, Gewaltverherrlichung und Spam schneller und konsistenter erkennen als menschliche Moderatoren allein. Meta setzt KI-Moderation bereits für Milliarden von Posts pro Monat ein und kann problematische Inhalte oft innerhalb von Sekunden nach dem Upload identifizieren. Für KMU, die Social-Media-Kanäle betreiben, bedeutet das weniger Risiko, dass die eigene Marke neben schädlichen Inhalten erscheint.

SynthID und digitale Wasserzeichen

Googles SynthID ist kein perfektes System, aber es zeigt den richtigen Weg: unsichtbare, robuste Wasserzeichen, die Inhalten eine verifizierbare digitale Herkunft geben. In Kombination mit den Fortschritten bei C2PA und dem kommenden kalifornischen AI Transparency Act könnte ein Ökosystem entstehen, in dem Nutzer mit einem Klick prüfen können, ob ein Inhalt menschlich oder maschinell erzeugt wurde.

Barrierefreiheit und Inklusion

KI-generierte Untertitel, automatische Bildbeschreibungen und Echtzeit-Übersetzungen machen Social-Media-Inhalte für Menschen mit Seh- oder Hörbehinderungen zugänglicher als je zuvor. Instagram und TikTok bieten KI-gestützte automatische Untertitel, die insbesondere für gehörlose und schwerhörige Nutzer einen erheblichen Zugewinn an Teilhabe darstellen.

Kreative Werkzeuge für Unternehmen

KI-gestützte Tools ermöglichen es auch kleinen Unternehmen, professionell aussehende Social-Media-Inhalte zu erstellen — von automatisch generierten Textvarianten über intelligente Bildbearbeitung bis hin zu personalisierten Feed-Algorithmen, die relevante Inhalte an die richtige Zielgruppe ausspielen. Die Demokratisierung kreativer Werkzeuge ist eine der positiven Seiten der KI-Revolution.

KI-gestützte Faktenprüfung

Tools wie Reality Defender nutzen maschinelles Lernen, um Deepfakes automatisch zu erkennen — unabhängig davon, ob die Inhalte ein C2PA-Label tragen oder nicht. Dieser Ansatz der Inferenz-basierten Erkennung ist ein wichtiges Korrektiv zum freiwilligen Labeling-System und kann auch Inhalte identifizieren, die bewusst ohne Kennzeichnung verbreitet werden. Für Unternehmen bieten solche Tools die Möglichkeit, die Echtheit von Inhalten zu verifizieren, bevor sie geschäftliche Entscheidungen darauf stützen.

Was können Sie tun? Empfehlungen für Unternehmen und Privatpersonen

Für Unternehmen und KMU

- Mitarbeiterschulungen zu Deepfake-Erkennung: Sensibilisieren Sie Ihr Team für KI-generierte Inhalte. Trainings zu „Voice Cloning“ und „CEO Fraud“ können erhebliche finanzielle Schäden verhindern.

- Verifizierungsprozesse einführen: Bevor Sie auf Social-Media-Inhalte geschäftlich reagieren, prüfen Sie die Quelle. Tools wie SynthID Detector und Reality Defender können dabei helfen.

- Eigene Inhalte kennzeichnen: Wenn Sie KI-Tools für die Content-Erstellung einsetzen, kennzeichnen Sie dies transparent. Authentizität wird zum Wettbewerbsvorteil.

- Cybersecurity-Strategie anpassen: Voice-Cloning-basierter Betrug und Deepfake-Phishing erfordern neue Sicherheitsprotokolle — insbesondere bei Überweisungsgenehmigungen und Identitätsprüfungen.

- Social-Media-Monitoring: Überwachen Sie, ob Ihr Unternehmensname oder Ihre Marke in KI-generierten Inhalten missbraucht wird.

Für Privatpersonen

- Quellenprüfung zur Gewohnheit machen: Bevor Sie einen emotionalen Post teilen, fragen Sie: Wer hat das veröffentlicht? Gibt es unabhängige Bestätigungen?

- KI-Erkennungstools nutzen: Googles SynthID Detector und ähnliche Tools können helfen, synthetische Inhalte zu identifizieren.

- Medienkompetenz stärken: Sprechen Sie mit älteren Familienmitgliedern über Deepfakes. Zeigen Sie Beispiele — nicht um Angst zu machen, sondern um ein gesundes Misstrauen gegenüber perfekt wirkenden Inhalten zu fördern.

- Algorithmische Blasen durchbrechen: Folgen Sie bewusst Quellen, die unterschiedliche Perspektiven bieten. KI-gesteuerte Feeds verstärken bestehende Überzeugungen.

- Nicht alles ist fake: Ebenso wichtig wie ein gesundes Misstrauen ist es, nicht in vollständigen Zynismus zu verfallen. Seriöser Journalismus und echte Inhalte existieren weiterhin — sie brauchen nur mehr Aufmerksamkeit.

Fazit: Die Wahrheit wird zur Teamarbeit

KI-generierte Desinformation auf Social Media ist kein zukünftiges Szenario — es ist die Gegenwart. Deepfakes, Bot-Netzwerke und synthetischer Content beeinflussen bereits heute, wie Millionen Menschen die Welt wahrnehmen, politische Entscheidungen treffen und einander vertrauen. Die Tech-Konzerne — von Meta über Google bis X — profitieren von der Aufmerksamkeitsökonomie, die KI-Content befeuert, und setzen eigene Transparenzmaßnahmen nur halbherzig um.

Gleichzeitig zeigen Initiativen wie SynthID, C2PA und der kalifornische AI Transparency Act, dass Gegenmaßnahmen möglich sind. Der Kampf gegen KI-Desinformation wird nicht durch eine einzelne Technologie gewonnen — sondern durch das Zusammenspiel von technischen Standards, gesetzlicher Regulierung, unabhängiger Forschung und individueller Medienkompetenz.

Für mittelständische Unternehmen bedeutet das: Cybersecurity endet nicht an der Firewall. Wer seine Mitarbeiter nicht auf KI-Desinformation vorbereitet, ist genauso verwundbar wie ein Unternehmen ohne Virenschutz. Die gute Nachricht ist, dass Unternehmen mit den richtigen Schulungen und Prozessen proaktiv handeln können. Hany Farid von der UC Berkeley fasste es pragmatisch zusammen: „I don’t think it solves the problem, but I think it takes a nice big chunk out of it.“

Häufig gestellte Fragen (FAQ)

Wie erkenne ich einen Deepfake?

Achten Sie auf unnatürliche Lippenbewegungen, inkonsistente Beleuchtung, verschwimmende Hände und fehlende Umgebungsgeräusche. Nutzen Sie Tools wie Googles SynthID Detector oder Reality Defender zur technischen Überprüfung. Im Zweifelsfall: Suchen Sie nach unabhängigen Quellen, die denselben Vorfall bestätigen.

Sind ältere Menschen besonders gefährdet?

Studien und Berichte — wie die BBC-Recherche zu „Decline Porn“ — zeigen, dass Menschen, die nicht mit KI-generierten Inhalten aufgewachsen sind, diese schwerer erkennen. Das bedeutet nicht, dass jüngere Generationen immun sind — aber die gezielte Ansprache älterer Zielgruppen durch Desinformations-Ersteller ist ein dokumentiertes Phänomen.

Was ist C2PA und schützt es mich?

Die C2PA (Coalition for Content Provenance and Authenticity) ist ein Industriestandard, der digitalen Inhalten ein Herkunftszertifikat gibt. Er bietet eine wichtige Grundlage, ist aber kein vollständiger Schutz: Die Teilnahme ist freiwillig, Labels können entfernt werden, und nicht alle Plattformen unterstützen ihn. X/Twitter nimmt nicht teil. Ab August 2026 wird Kalifornien als erster US-Bundesstaat KI-Labeling gesetzlich vorschreiben.

Was können Unternehmen gegen Deepfake-Betrug tun?

Implementieren Sie Zwei-Faktor-Verifizierung für alle kritischen Geschäftsentscheidungen — insbesondere Überweisungen. Trainieren Sie Mitarbeiter regelmäßig auf Voice-Cloning- und Phishing-Angriffe. Nutzen Sie technische Tools zur Deepfake-Erkennung und etablieren Sie klare Eskalationsprozesse für verdächtige Kommunikation. Eine professionelle Cybersecurity-Beratung kann helfen, diese Prozesse aufzusetzen.

Ihr Unternehmen vor KI-Betrug und Desinformation schützen

Wir beraten mittelständische Unternehmen in Köln und Umgebung zu den Risiken von KI-Desinformation und unterstützen Sie bei Cybersecurity-Maßnahmen, KI-Strategie und Mitarbeiterschulungen. Transparent, fachlich fundiert und ohne leere Versprechen.